Difference between revisions of "Orange: AdaBoost"

Onnowpurbo (talk | contribs) |

Onnowpurbo (talk | contribs) |

||

| Line 3: | Line 3: | ||

| − | + | Sebuah ensemble meta-algoritma yang menggabungkan learner yang lemah dan beradaptasi dengan 'kekerasan' masing-masing sampel training. | |

==Input== | ==Input== | ||

| Line 16: | Line 16: | ||

Model: trained model | Model: trained model | ||

| − | + | Widget AdaBoost (singkatan dari “Adaptive boosting”) adalah algoritma machine-learning, yang di formulasikan oleh Yoav Freund and Robert Schapire. Ini dapat digunakan dengan algoritma learner lainnya untuk meningkatkan kinerja mereka. Itu dilakukan dengan mengutak-atik learner yang lemah. | |

| − | AdaBoost | + | AdaBoost dapat bekerja baik untuk task classification maupun regression. |

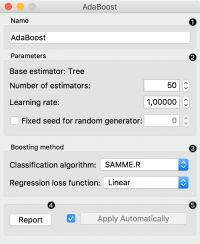

[[File:AdaBoost-stamped.png|center|200px|thumb]] | [[File:AdaBoost-stamped.png|center|200px|thumb]] | ||

| Line 37: | Line 37: | ||

==Contoh== | ==Contoh== | ||

| − | + | Untuk classification, kita load iris dataset. We menggunakan AdaBoost, Tree dan Logistic Regression dan mengevaluasi performance model di widget Test & Score. | |

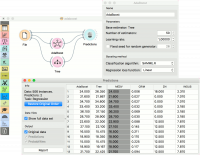

[[File:AdaBoost-classification.png|center|200px|thumb]] | [[File:AdaBoost-classification.png|center|200px|thumb]] | ||

| − | + | Untuk regression, kita load housing dataset, kirim data instances ke dua model yang berbeda (AdaBoost dan Tree) dan keluarannya ke widget Predictions. | |

[[File:AdaBoost-regression.png|center|200px|thumb]] | [[File:AdaBoost-regression.png|center|200px|thumb]] | ||

Revision as of 04:24, 7 March 2020

Sumber: https://docs.biolab.si//3/visual-programming/widgets/model/adaboost.html

Sebuah ensemble meta-algoritma yang menggabungkan learner yang lemah dan beradaptasi dengan 'kekerasan' masing-masing sampel training.

Input

Data: input dataset Preprocessor: preprocessing method(s) Learner: learning algorithm

Output

Learner: AdaBoost learning algorithm Model: trained model

Widget AdaBoost (singkatan dari “Adaptive boosting”) adalah algoritma machine-learning, yang di formulasikan oleh Yoav Freund and Robert Schapire. Ini dapat digunakan dengan algoritma learner lainnya untuk meningkatkan kinerja mereka. Itu dilakukan dengan mengutak-atik learner yang lemah.

AdaBoost dapat bekerja baik untuk task classification maupun regression.

- The learner can be given a name under which it will appear in other widgets. The default name is “AdaBoost”.

- Set the parameters. The base estimator is a tree and you can set:

- Number of estimators

- Learning rate: it determines to what extent the newly acquired information will override the old information (0 = the agent will not learn anything, 1 = the agent considers only the most recent information)

- Fixed seed for random generator: set a fixed seed to enable reproducing the results.

- Boosting method.

- Classification algorithm (if classification on input): SAMME (updates base estimator’s weights with classification results) or SAMME.R (updates base estimator’s weight with probability estimates).

- Regression loss function (if regression on input): Linear (), Square (), Exponential ().

- Produce a report.

- Click Apply after changing the settings. That will put the new learner in the output and, if the training examples are given, construct a new model and output it as well. To communicate changes automatically tick Apply Automatically.

Contoh

Untuk classification, kita load iris dataset. We menggunakan AdaBoost, Tree dan Logistic Regression dan mengevaluasi performance model di widget Test & Score.

Untuk regression, kita load housing dataset, kirim data instances ke dua model yang berbeda (AdaBoost dan Tree) dan keluarannya ke widget Predictions.